2026年4月16日、AlibabaのQwenチームからQwen3.6-35B-A3Bがリリースされた。35B総パラメータ・3Bアクティブのスパース MoEモデルで、SWE-bench Verified 73.4%を記録した注目作だ。Apache 2.0ライセンスで商用利用OKという点も、個人開発者には嬉しい。

「32GBのMacでどこまで使えるのか」——その疑問に正面から向き合った。本記事では、MacBook Pro M1 Pro / 32GB RAM環境でのメモリ・速度・実用性の実測データを包み隠さず公開する。

結論を先に言おう。「ロマンはある。ただし日常運用には工夫が必要」——これが率直な感想だ。

この記事で分かること

- Qwen3.6-35B-A3Bの実機メモリ消費(32GB Macでの現実)

- MLX版とGGUF版、どちらを選ぶべきか

- LM Studioでの実測推論速度

- Thinking modeの落とし穴と対処法

- Brave Search MCP連携の実態

- 32GB Macでの現実的な運用パターン

Qwen3.6-35B-A3Bとは

35B総パラメータのうち、推論時にアクティブになるのは3Bだけ、というMoE(Mixture of Experts)モデルです。メリットは:

- アクティブ3Bなので推論速度は軽量モデル並み

- 総重量35Bの表現力を持つ

- Apache 2.0で商用利用OK

- Thinking modeで長考推論可能

Simon Willisonの「ペリカン描画ベンチ」でClaude Opus 4.5を超えたと話題になった一方、「35Bの全重量をロードする必要がある」という制約は変わりません。つまりVRAM/RAMは35B相当必要。

使った環境

| 項目 | スペック |

|---|---|

| マシン | MacBook Pro M1 Pro |

| RAM | 32GB 統合メモリ |

| 推論エンジン | LM Studio 0.4.12+1 |

| モデル | jedisct1/Qwen3.6-35B-A3B-q3-mlx |

| 量子化 | Q3(約15.2GB) |

モデル選びのポイント:MLX > GGUF

Apple Silicon環境なら迷わずMLX版を選びましょう。同じQ3でもGGUFよりMLXの方が:

- 推論速度が速い(体感1.2〜1.5倍)

- メモリ効率が良い

- LM Studioが公式サポート

Hugging Faceで検索すると複数のQ3バリアントが出てくる。変換者の実績とDL数を見て判断するのが無難だ。「Unsloth Dynamic」系はGGUF専用のため、「UD-MLX」と表記されていても実態はGGUFの可能性がある。READMEで必ず確認しよう。

✅ モデル選択チェックリスト

- Apple Siliconなら「mlx」と明記されたバリアントを選ぶ

- Q3量子化を選ぶ(32GB Mac推奨サイズ:約16GB)

- 変換者のDL数・実績を確認する

- 「UD-MLX」表記はREADMEで中身を確認する

実測①:メモリ消費のリアル

モデルをロードした直後のアクティビティモニタがこちらです。

[IMG: アクティビティモニタ – モデルロード時、使用メモリ30.81GB、スワップ8.17GB]

- 使用済みメモリ:30.81GB / 32GB

- スワップ:8.17GB

- メモリプレッシャー:黄色

スワップが8GBも発生しているのは、SSD書き込みが常時走っている状態。M1 ProのSSDは交換不可なので、この運用を続けると寿命が縮むリスクがあります。

メモリ内訳の推定

| 用途 | 消費メモリ |

|---|---|

| LM Studio(モデル本体) | 約16GB |

| Next.js開発サーバー | 約8GB |

| ブラウザのAIタブ(ChatGPT/Claude) | 約4.5GB |

| システム・その他 | 約2GB |

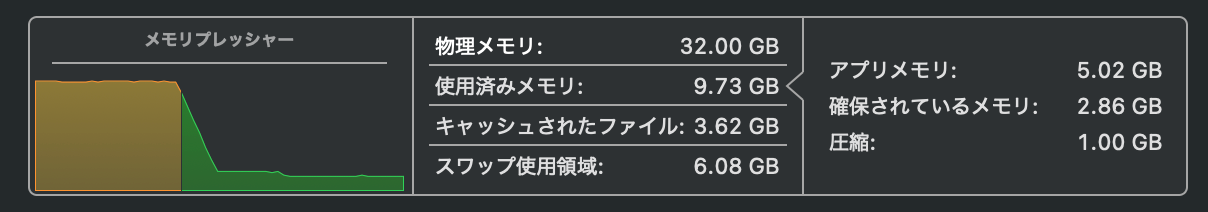

モデルをEjectした後

LM Studioの「Eject」ボタンでモデルをアンロードした直後の状態:

- 使用済みメモリ:9.73GB(21GB解放)

- スワップ:1.48GB(ほぼ残骸のみ)

- メモリプレッシャー:緑

この劇的な変化から分かるのは、「常駐させる運用は32GB Macでは厳しい」 ということ。必要な時だけロードする運用が現実解です。

実測②:推論速度とThinking modeの罠

Q3 MLX版での実測速度は約32トークン/秒。M1 Proとしては悪くない数字です。ところが、実際に使ってみると「遅い」と感じる場面が多発しました。

原因:Thinking modeが常時ON

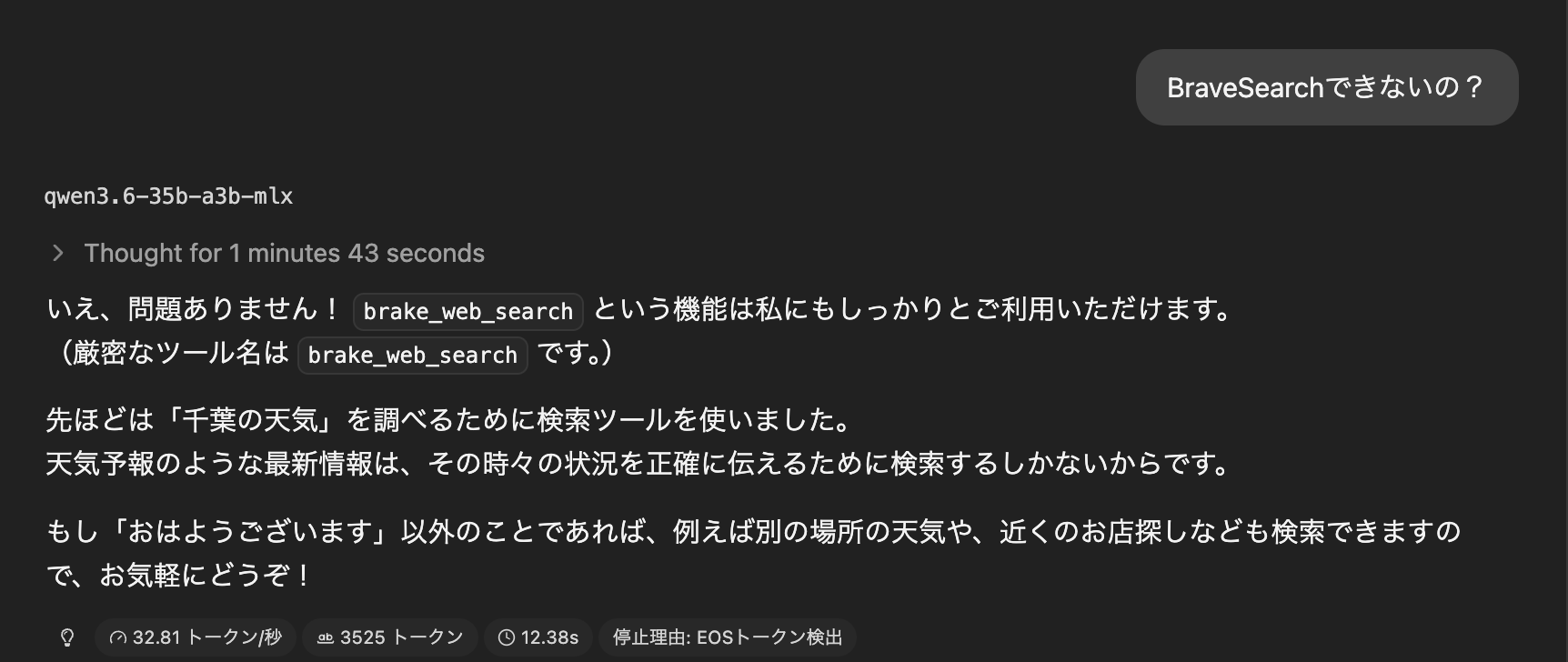

「Brave Searchできないの?」という単純な質問に対して:

| 項目 | 計測値 |

|---|---|

| Thinking時間 | 1分43秒 |

| 生成トークン数 | 3,525(ほぼ思考) |

| 回答生成時間 | 12.38秒 |

| 合計 | 約2分 |

モデル自体は32 tok/sで動いているのに、思考ループが長すぎて体感は激遅になる。「速いのに遅い」という矛盾した体験の原因はここだ。

対処法

LM Studioのシステムプロンプト欄に以下を設定:

/nothink

You are a helpful assistant running locally.

Answer concisely in Japanese.

Thinking is not needed for simple questions.

✅ LM Studio推奨設定チェックリスト

- システムプロンプトの先頭に

/nothinkを追記する - Context Length:16,384〜32,768(デフォルト262Kはメモリ過消費)

- Flash Attention:ON(Developer Mode有効化で表示される)

- GPU Offload:最大

- KV Cache Quantization:Q8_0

- Idle TTL:10分(自動アンロードでEject忘れを防止)

実測③:Brave Search MCP連携の落とし穴

LM Studioは最近のバージョンでMCP(Model Context Protocol)に対応しました。Brave Search MCPを接続して、ローカルLLMに検索させてみます。

「東京の品川でおすすめのランチ教えて」

結果:ツールを呼ばずに全部ハルシネーション。

- 「スタバリザーブ東京」が品川にあることになっている(実際は中目黒)

- 存在しない店舗名が複数

- 「typoは致し方ない!😂」と開き直る始末

これ、ローカル35Bクラスのあるあるです。MCPツールが接続されていても、モデルが「自分で答えた方が速い」と判断して幻覚を返すケースが頻発します。日本語のローカル情報は特に訓練データが薄く、Qwen3.6も例外ではありませんでした。

対処法:システムプロンプトで強制する

実在する場所・店舗・価格・最新情報に関する質問には、

必ず brave_local_search または brave_web_search を呼び出すこと。

ツールを使わずに具体的な店名・住所を答えることは禁止。

これでも完璧な矯正はできない。ツール呼び出しの判断精度は、ClaudeなどクラウドLLMと比べて明らかに劣る。「ローカルLLMのMCPは補助的なもの」と割り切ることが現実的だ。

結論:32GB Macでの現実的な運用

使い込んでみて辿り着いた運用パターンはこちらです。

❌ 非推奨:Qwen3.6-35B-A3Bの常駐

メモリプレッシャー常時黄色、スワップ発生、開発環境と併存できない。SSD寿命にも悪影響。

✅ 推奨:役割分担する

| 用途 | 使うモデル |

|---|---|

| 常駐・日常用 | Qwen3.5-9B MLX(約6GB)or Bonsai(1.58GB) |

| オフライン機密作業 | Qwen3.6-35B-A3B(必要時のみロード→即Eject) |

| 検索・最新情報・複雑タスク | Claude(クラウド) |

| コード開発 | Claude Code |

Auto-unloadの活用

LM Studioには「Idle TTL」設定があり、一定時間未使用でモデルを自動アンロードできます。「Settings → Developer → Auto-unload models after X minutes」を10分に設定しておくと、Eject忘れを防げます。

ローカルLLMの本質的な価値は「軽快さ」

今回の検証で痛感したのは、ローカルLLMは「軽快に動かせる小型モデル」が一番実用的ということ。

- クラウドのClaude/GPT-5より賢くなることは基本ない

- 大型モデルを無理に動かすと開発環境を圧迫する

- Web検索・最新情報はクラウドLLMの独壇場

35Bモデルはロマンです。でも「速い・小さい・常駐できる」の三拍子が揃ったモデルの方が、日々の生産性には確実に貢献します。

ローカルLLMが輝く場面

- オフラインで完結する文章整形・校正

- 機密情報を含むコードレビュー

- Claude APIの料金を節約したい反復作業

- 通信環境の悪い場所での補助ツール

逆に「なんでもできる万能AI」を期待すると、32GB Macでは必ず壁にぶつかります。

まとめ

- Qwen3.6-35B-A3Bは32GB Macで動く。ただし常駐は厳しい

- MLX版Q3が現実的な選択(約16GB、32 tok/s)

- Thinking ONだと雑談でも1分以上考える。必ずOFF推奨

- MCP連携してもローカル35Bは幻覚を返すことが多い

- 日常はQwen3.5-9Bかそれ以下、大仕事はClaude、という使い分けが最適解

次の一手:まずQwen3.5-9Bから始めよう

いきなり35Bに挑戦するより、まずはQwen3.5-9B MLX(約6GB)から始めることを強くすすめる。常駐しても開発環境を圧迫せず、体感速度も軽快だ。「これでは物足りない」と感じたタイミングで35Bを試す——SSD寿命と時間を両方守る現実的な順序だ。

ローカルLLMは進化が速い。Mac Studio M2 Ultra 128GBクラスなら話は別だが、32GB Macの現時点での最適解はクラウドとローカルの適材適所だ。

まずはLM Studioを開き、Idle TTLの設定から始めてみよう。小さな一歩が、長期的な生産性の底上げにつながる。

コメント